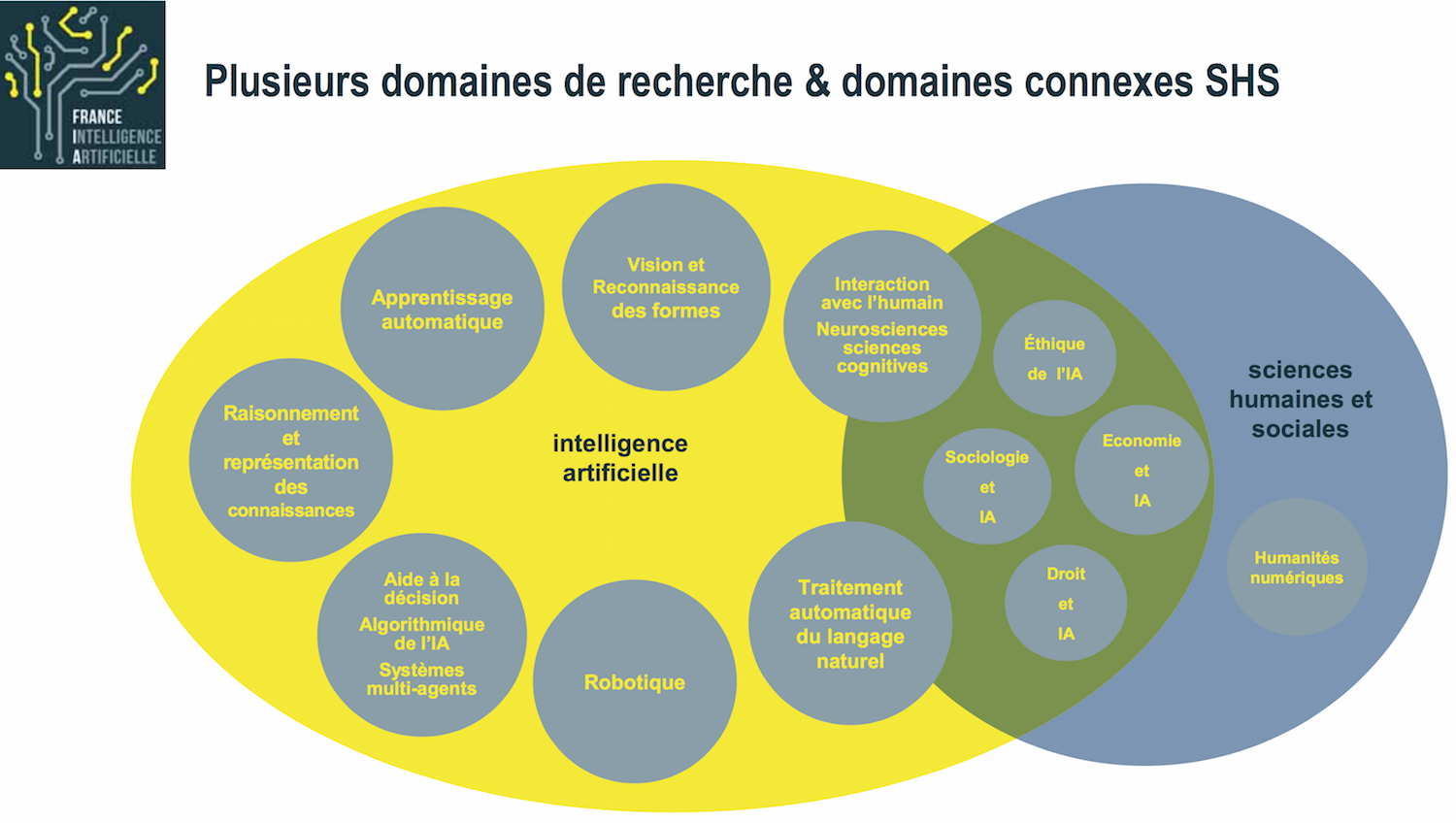

« L’enjeu principal est d’affirmer le leadership mondial de la France sur la recherche en intelligence artificielle », annonce d’emblée ce rapport demandé en janvier 2017 par le secrétaire d’État chargé de l’industrie, du numérique et de l’innovation et le secrétaire d’État chargé de l’enseignement supérieur et de la recherche, dont l’objet est d’élaborer une stratégie nationale destinée à confirmer la place de la France, au premier plan dans le domaine de l’intelligence artificielle. Le rapport fait état de la grande diversité des domaines de recherche, allant de l’apprentissage automatique à la robotique, en passant par l’interaction avec l’homme, l’éthique, le droit ou encore les humanités numériques.

Si le concept de l’intelligence artificielle remonte aux années 1950 et si les premiers travaux de recherche sur les algorithmes date des années 1980, la prolifération exponentielle des données et l’augmentation de leur capacité de stockage, l’accroissement des capacités de calcul et la diminution constante de leur coût ont ouvert depuis cinq ans « des perspectives dont on ne perçoit pas encore les limites ». En Corée du Sud, en Chine et au Japon mais aussi au Canada ou encore aux États-Unis, de grandes initiatives nationales, publiques et privées, drainent d’importants capitaux, faisant de l’intelligence artificielle un enjeu majeur de recherche et développement, de création de nouveaux produits et services et d’innovation dans de nombreuses filières industrielles.

Il s’agissait pour le gouvernement de mobiliser l’ensemble de la communauté française de l’IA, afin d’élaborer une stratégie nationale visant à accompagner son appropriation par le tissu économique, mais aussi à répondre aux craintes que celle-ci peut susciter. Les travaux ont été articulés autour de trois grands thèmes : « Orienter la recherche amont et développer les compétences » ; « Industrialiser et transférer les technologies de l’IA vers les secteurs économiques en maximisant les retombées économiques sur le territoire national » ; « Préparer un cadre favorisant le développement de l’IA en prenant en compte les considérations macroéconomiques et sociales, éthiques, de souveraineté et de sécurité nationale ».

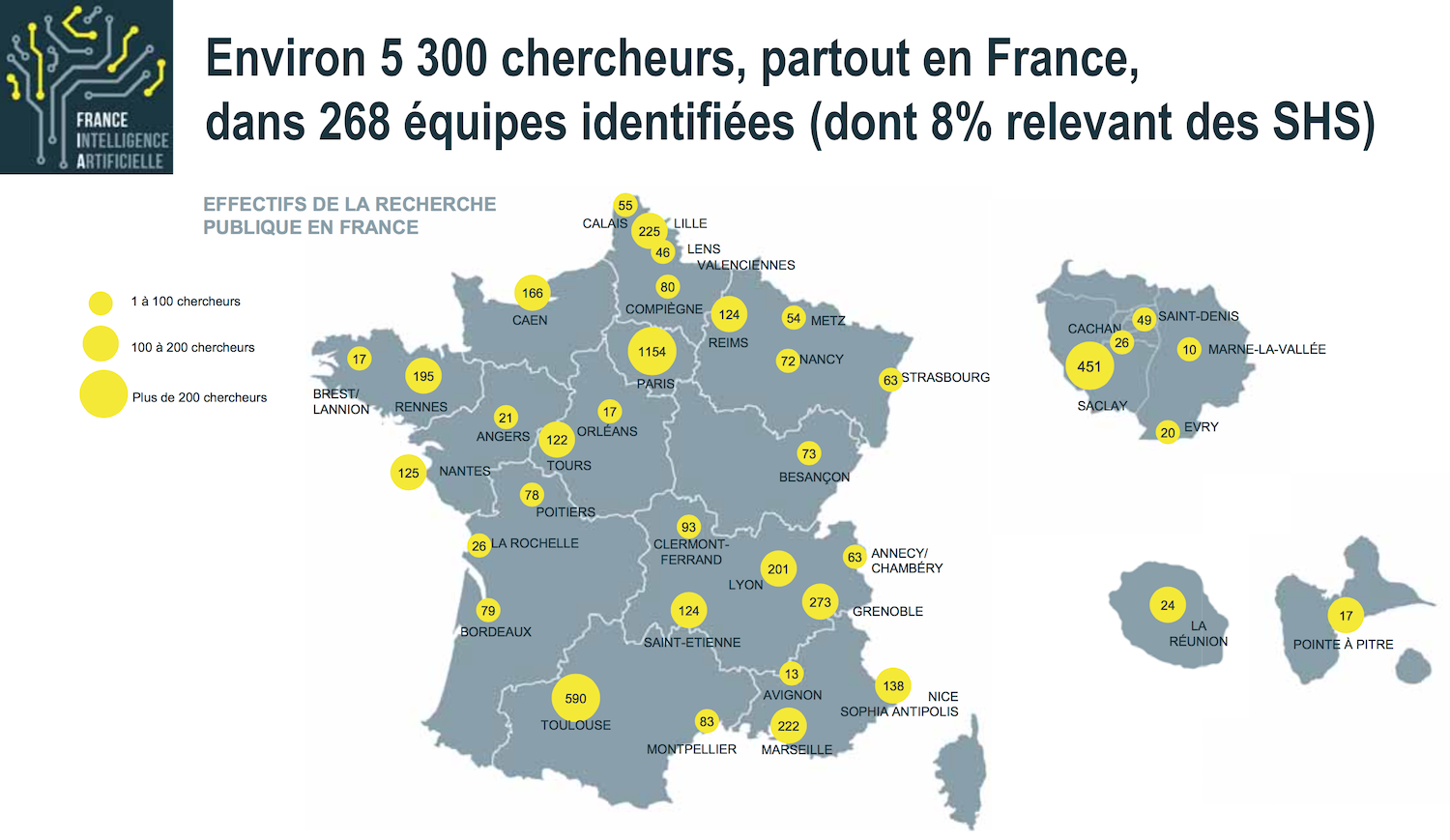

Parmi les groupes de travail, celui consacré à la « Cartographie » avec pour objectif « d’établir un premier état des lieux des compétences des équipes académiques françaises afin de contribuer à l’élaboration et la mise en œuvre de la stratégie française », met en lumière la diversité et la richesse de l’IA en France.

Source : Rapport #FranceIA.

On ne le fait pas valoir suffisamment mais la France possède de sérieux atouts. Quelque 260 équipes de recherche en intelligence artificielle pure mais aussi en sciences humaines et sociales (droit, économie, sociologie…) représentent 5 300 chercheurs répartis dans la France entière, dont 4 000 hors de la région parisienne.

Source : Rapport #FranceIA

Le rapport fait également état de la grande diversité des domaines de recherche, allant de l’apprentissage automatique à la robotique, en passant par l’interaction avec l’homme, l’éthique, le droit de l’intelligence artificielle ou encore les humanités numériques. La France compte ainsi parmi les quatre premiers pays au monde pour la publication d’articles scientifiques sur l’intelligence artificielle, avec la Chine, les États-Unis, et le Royaume-Uni.

Le rapport #FranceIA s’est également attaché à préparer un cadre favorable au développement de l’intelligence artificielle en France, tout en soulevant de nombreuses questions quant aux enjeux d’ordre économique, sociologique et éthique, ainsi que ceux liés à la souveraineté et la sécurité.

Le groupe de travail « Souveraineté et sécurité nationale » s’est intéressé à l’impact de l’intelligence artificielle sur la souveraineté définie comme la « capacité d’une entité à maîtriser des attributs dont elle revendique avoir le contrôle ». Souveraineté et sécurité nationale lorsqu’elle s’exerce au niveau de l’État, mais aussi souveraineté au niveau de l’individu, lorsqu’il s’agit de la protection de la personne et de ses données personnelles, et enfin au niveau de l’entreprise, lorsqu’il s’agit de propriété industrielle.

Si la cybersécurité classique comme le chiffrement de données, l’authentification ou encore le contrôle d’accès ne recourt pas à l’intelligence artificielle, cette dernière peut néanmoins apparaître comme une opportunité dès lors qu’elle serait utilisée pour « la détection de failles de sécurité, de fuites de données voire l’automatisation de certaines tâches de traitement d’incident ».

Les enjeux – c’est-à-dire les opportunités et les menaces – sont particulièrement identifiés lorsqu’il s’agit de définir un cadre de confiance pour l’utilisation de l’intelligence artificielle au bénéfice des citoyens.

Les programmes d’intelligence artificielle se nourrissent de données dont le volume influe directement sur leur efficacité. Or, le partage de données personnelles entraîne des risques importants en matière de protection de la vie privée et d’atteinte à la dignité humaine. L’intelligence artificielle permet de « désanonymiser » certaines données, d’exercer un profilage très précis grâce aux techniques d’apprentissage profond (deep learning). Pour encadrer ces risques, la France devra être en mesure de garantir au citoyen qu’il pourra effectivement maîtriser l’usage fait de ses données personnelles. C’est à la fois le principe d’autodétermination informationnelle, introduit par la loi pour une République numérique (voir La rem n°41, p.15), mais aussi le respect de la transparence des algorithmes publics qui permettront d’offrir un « climat de confiance relatif aux traitements des données réalisées par des algorithmes d’intelligence artificielle ». D’un point de vue technique, la « privacy by design », – prise en compte de la notion du respect de la vie privée dès la conception –, devra également « renforcer la compréhension de ce que font réellement les systèmes reposant sur l’intelligence artificielle ».

Le groupe de travail « Stratégie nationale en intelligence artificielle », copiloté par le Conseil national du numérique et France Stratégie, avait pour objectif d’anticiper les impacts économiques et sociaux de l’intelligence artificielle. Si cette dernière a d’abord été considérée comme la cause de la suppression des emplois, essentiellement ceux avec des tâches répétitives, les « progrès spectaculaires obtenus par la recherche en la matière prédisent également un impact sur « les emplois basés sur les talents », dont les scénarios touchent potentiellement beaucoup plus de monde. Loin de se focaliser sur cette hypothétique disparition massive d’emplois, le rapport #FranceIA s’attache plutôt à analyser les perspectives positives et concrètes, comme les gains de productivité dans les entreprises, l’amélioration de la qualité des services, au regard des menaces potentielles telles que le danger de perte d’indépendance économique, l’absence de gouvernance des transformations, la sous-estimation des conséquences sur la vie quotidienne, en particulier dans le monde du travail, dont l’avenir passerait par « une nécessaire inventivité dans les accompagnements, en particulier par l’appareil de formation ».

L’ambition du groupe de travail « Stratégie nationale en intelligence artificielle » aura été de mettre en lumière l’impact de « l’apprentissage machine » sur la production, « la capacité d’un logiciel informatique à reproduire avec une très bonne qualité certaines aptitudes humaines dès lors que des données d’entraînement en quantité suffisante sont disponibles », en rappelant que ce qui fait la valeur de ces programmes, ce sont les données et non l’algorithme lui-même. Parce que la qualité et le volume des données prévalent sur le reste, « les entreprises ou les administrations doivent se concentrer sur l’identification des données susceptibles d’être utilisées et sur les modalités concrètes d’exploitation – mise à disposition des données, éventuellement mutualisation, en conservant le contrôle des exploitations qui en sont faites ou en bénéficiant d’un juste retour ». Par ailleurs, des interrogations subsistent quant à la libre circulation des données, lorsqu’elles traversent les frontières, mais aussi lorsqu’elles sont échangées entre des acteurs économiques d’un même pays.

Enfin, le groupe de travail souligne qu’il ne s’agira pas tant de la suppression pure et simple d’emplois que de la transformation du travail, le but étant d’accompagner les professionnels et les entreprises dans ces mutations, plutôt que de voir l’intelligence artificielle comme un moyen de mécaniser les humains. Le rapport appelle donc à des politiques publiques, nationales et régionales, ayant pour but de « créer de la valeur dans le travail pour tous », en s’appuyant sur des « plateformes plurielles d’évaluation et de co-conception des transformations ».

Selon le groupe de travail, l’outil essentiel qui permettra de relever ces défis reste la formation. « L’IA est un chantier de formation professionnelle essentiel qui peut servir de cas d’école pour les nouvelles visions de l’éducation et de la formation qui sont depuis plusieurs années débattues dans la société : importance des compétences transversales (soft skills), littératie numérique, à laquelle il faut adjoindre une littératie de l’IA. Une telle formation passe par une éducation informatique générale et une mobilisation de la société sur les formations initiales (entreprises, secteur de l’éducation populaire) mais aussi une inventivité dans les formations sur poste, les formations en conception, ce qui implique une forte mobilisation des entreprises elles-mêmes, de la recherche et des partenaires sociaux pour aboutir à de nouvelles voies ». Plutôt que de considérer l’IA comme principal facteur de suppression massive d’emplois, le groupe de travail insiste sur la mutation des métiers entraînée par l’intelligence artificielle, en se concentrant davantage sur la complémentarité entre l’homme et la machine plutôt que sur leur rivalité.

En s’attelant sans tarder à l’immense chantier de l’IA, la France doit « sortir d’une vision simpliste (compréhension « magique » de l’IA, focalisation sur la disparition massive d’emplois, idée que l’IA nous tombe dessus quoi que l’on fasse induisant une passivité devant le choc annoncé) », pour anticiper les évolutions et les mutations à venir. L’enjeu est de taille : construire une société à la fois moderne et « inclusive », celle qui saura garantir « le respect des valeurs humaines aux stades de la conception, de l’acceptation, de l’appropriation et de l’utilisation de ces systèmes ».

France Intelligence Artificielle, rapport gouvernemental, synthèse des groupes de travail, mars 2017